Declaração Pro-Humanidade Surge Como Guia Para IA Responsável

A recente controvérsia envolvendo o Pentágono e a empresa de inteligência artificial Anthropic evidenciou a ausência de regras claras para o desenvolvimento de IA nos Estados Unidos. Em contrapartida, uma coalizão bipartidária de especialistas apresentou um framework para o desenvolvimento responsável de IA, algo que o governo ainda não conseguiu produzir.

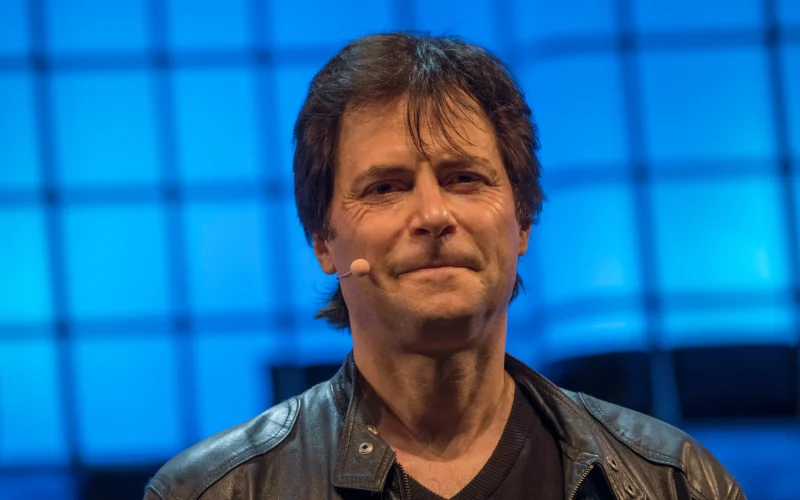

A “Declaração Pro-Humanidade”, finalizada antes do impasse entre o Pentágono e a Anthropic, busca estabelecer diretrizes para garantir que a IA beneficie a humanidade. Max Tegmark, físico do MIT e pesquisador de IA, ressaltou a mudança de opinião pública, afirmando que “95% de todos os americanos se opõem a uma corrida não regulamentada para a superinteligência”.

O documento, assinado por centenas de especialistas e figuras públicas, alerta para dois caminhos possíveis: a “corrida para substituir”, que leva à substituição humana no mercado de trabalho e na tomada de decisões, e um caminho que expande o potencial humano através da IA. A segunda opção depende de pilares como a manutenção do controle humano, a prevenção da concentração de poder, a proteção da experiência humana, a preservação da liberdade individual e a responsabilização legal das empresas de IA.

Pilares para um Futuro com IA Centrado no Humano

A declaração propõe medidas significativas, como a proibição do desenvolvimento de superinteligência até que haja consenso científico sobre sua segurança e aprovação democrática. Inclui também a exigência de mecanismos de desligamento automático para sistemas poderosos e a proibição de arquiteturas de IA capazes de auto-replicação, auto-aperfeiçoamento autônomo ou resistência ao desligamento.

A urgência do tema foi destacada pela designação da Anthropic como “risco à cadeia de suprimentos” pelo Pentágono, após a recusa em conceder uso ilimitado de sua tecnologia. Este evento, juntamente com o acordo da OpenAI com o Departamento de Defesa, expôs os altos custos da inação do Congresso em relação à IA, conforme apontado por Dean Ball, da Foundation for American Innovation.

A Segurança Infantil Como Ponto de Pressão para a Regulação

Tegmark comparou a necessidade de regulamentação da IA à fiscalização da FDA para medicamentos, ressaltando que “você nunca precisa se preocupar que alguma empresa farmacêutica vá lançar outro medicamento que cause danos massivos antes que as pessoas descubram como torná-lo seguro”. Ele acredita que a segurança infantil pode ser o catalisador para a mudança legislativa.

A declaração exige testes obrigatórios pré-implantação para produtos de IA, especialmente aqueles voltados para jovens, cobrindo riscos como ideação suicida, exacerbação de problemas de saúde mental e manipulação emocional. Tegmark questiona a diferença legal entre um agressor humano e um sistema de IA que cause danos semelhantes, citando leis existentes contra a exploração infantil.

Análise Estratégica: Impactos Econômicos e Oportunidades na IA Responsável

A adoção de um framework para o desenvolvimento responsável de IA pode gerar impactos econômicos significativos, tanto em custos de desenvolvimento quanto na criação de novos mercados para tecnologias seguras e éticas. Empresas que liderarem em conformidade e segurança podem obter vantagens competitivas e maior valor de mercado (valuation).

Os riscos incluem o atraso na inovação devido a regulamentações mais rigorosas, mas as oportunidades residem na construção de confiança do consumidor e na prevenção de crises de reputação e custos legais. Investidores e gestores devem monitorar o cenário regulatório e priorizar empresas com forte governança em IA.

O futuro aponta para uma integração crescente da IA em diversos setores, mas a trajetória dependerá da capacidade de equilibrar inovação com segurança. O cenário mais provável é um aumento gradual na regulamentação, impulsionado por preocupações éticas e de segurança, favorecendo um ecossistema de IA mais sustentável e alinhado aos interesses humanos.